inVibe

Les mouvements de nos yeux comme notre perception de l’environnement sont principalement dépendant de la capacité du système visuel à extraire des informations sur la position et le mouvement des objets dans l’environnement. L’équipe INVIBE étudie comment ces informations sont extraites et représentées de façon probabiliste au sein de représentations corticales et sous-corticales dynamiques. Nos travaux combinent des approches comportementales (psychophysique visuelle, oculomotricité), physiologiques (électrophysiologie, imagerie par IRM, perturbations) et théoriques (modélisation). L’objectif est de mieux comprendre comment un réseau distribué de représentations rétinotopiques combine des informations sensorielles et cognitives pour adapter nos mouvements oculaires aux trajectoires complexes des objets en mouvement.

L’inférence dynamique: quels sont les principes computationnels sous-jacents aux transformations visuo-motrices ?

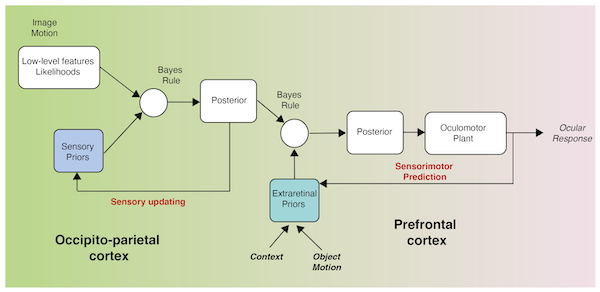

Pour adapter nos comportements de façon optimale et dynamique en fonction du contexte, le cerveau combine des informations sensorielles (la position ou le mouvement d’un objet) et cognitives (nos connaissances a priori sur les trajectoires naturelles de cet objet. L’inférence Bayesienne fournit un cadre théorique pour comprendre cette intégration dynamique dans ces boucles récurrentes liant les différentes populations représentant ces différents types d’information. Anna Montagnini et Guillaume Masson étudient les propriétés de cette inférence en manipulant les propriétés statistiques des informations sensorielles ou celles des connaissances a priori. Ils ont développé une approche visant à extraire la dynamique de ces calculs à partir du décours temporel des mouvements de poursuite oculaire.

Quels sont les réseaux corticaux et sous-corticaux contrôlant les mouvements oculaires ?

Les mouvements oculaires d’exploration (saccades) et de stabilisation (poursuite) mobilisent de vastes population neuronales prémotrices corticales (réseau occipito-parieto-frontal) et sous-corticales (colliculus supérieur, cervelet) et motrices (noyaux cerebelleux et oculomoteurs). Laurent Goffart, Guilhem Ibos et Guillaume Masson étudient ces dynamiques neurales de prise de décision (vers où et quand bouger les yeux) et de contrôle (comment bouger les yeux) chez le singe. Martin Szinte, Anna Montagnini et Guillaume Masson explorent chez l’homme le rôle de ces structures dans l’inférence dynamique.

Agir de façon adaptée et percevoir dans un monde stable

Une caractéristique fondamentale des mouvements oculaires et que chaque déplacement du regard affecte le capteur sensoriel lui-même: l’image du monde bouge avec nos yeux et pourtant notre perception de ce même monde est remarquablement stable. Comment adaptons-nous notre système moteur et nos représentations sensorielles pour extraire l’information de façon optimale et organiser notre perception du monde tridimensionnel. Martin Szinte, Manuel Vidal, Anna Montagnini et Guillaume Masson étudient comment se construit la dynamique de ces boucles perception-action remarquables et comment elle s’imprime dans les représentations sensorielles et cognitives.

Perception, cognition et métacognition visuelle: une même dynamique computationnelle ?

Nos bougeons nos yeux pour prendre de l’information de façon active. Nous sommes également capable d’estimer si une décision perceptive ou sensori-motrice est fiable. Ces propriétés cognitives (agentivité, confiance) sont elles supra modulaires ou bien au contraire émergent-elles de la dynamique de ces mêmes représentations hiérarchiques ? Andrea Desantis, Manuel Vidal, Anna Montagnini et Guillaume Masson cherche à comprendre comment ces jugements dits métacognitifs sont en réalité des propriétés computationnelles fondamentales de ces représentations dynamiques mêlant flux sensoriels et connaissances.

Une équipe interdisciplinaire mêlant les niveaux d’approches

L’équipe conduit ces travaux chez l’Homme et chez deux espèces de primate non-humains (singe macaque et marmoset). Elle combine des techniques de psychologie expérimentale et de neurosciences des comportements (psychophysique du mouvement visuel, oculomotricité) avec des approches physiologiques corrélatives ou causales. Chez l’Homme, nous étudions les dynamiques neuronales grâce à des techniques non invasives d’imagerie (IRM 3T et 7T, EEG) et de perturbation (TMS). Chez le singe, nous combinons électrophysiologie de masse (électrode unique, en matrice ou laminaire) et perturbations réversibles (pharmacologie).